Votre prochain coup d’un soir, ce sera un robot ? Les robots tueurs, c’est pour bientôt ? Et si les robots remplaçaient les juges lors des procès ? On a interviewé des experts en la matière, on vous dit tout…

L’intelligence artificielle nourrit nos fantasmes les plus dingues et réveille des passions. A tel point qu’on oublie parfois qu’on n’est pas dans un film de science-fiction… Cinq clichés décortiqués.

1. « Les robots vont dominer le monde et tous nous tuer »

Blade Runner

L’année passée, un laboratoire de Facebook crée deux chatbots capables de négocier l’un avec l’autre. Résultat ? Les IA ont fini par créer leur propre langage, incompréhensible pour les humains… Si l’expérience paraît flippante, elle n’a en réalité pas troublé les chercheurs. Et on est encore loin du temps où les robots comploteront dans leur langue pour tous nous dégommer. Pour beaucoup, l’IA forte, dotée de conscience et capable d’émotion, fera toujours partie du domaine de la science-fiction. Ce qui inquiète en revanche, ce sont les robots tueurs autonomes, déjà bien réels.

« C’est là où se situe le véritable danger pour la plupart des personnes qui travaillent dans l’intelligence artificielle », explique Yves Deville, professeur d’informatique à l’Ecole Polytechnique de Louvain. « Lorsqu’un Américain pilote un drone à partir de son salon, c’est lui qui décide d’appuyer ou non sur le bouton pour tuer des gens. Ici, on parle de logiciels entraînés pour sélectionner des cibles et les attaquer sans intervention humaine. Ces armes ne sont pas encore sur les champs de bataille mais on est déjà dans l’expérimental. En terme de danger pour la race humaine, les armes létales autonomes sont comparables au nucléaire… Il faut que les chercheurs et les autorités s’engagent à ne pas faire de recherche dans ce domaine. Comme pour les armes chimiques, une convention devrait être signée. »

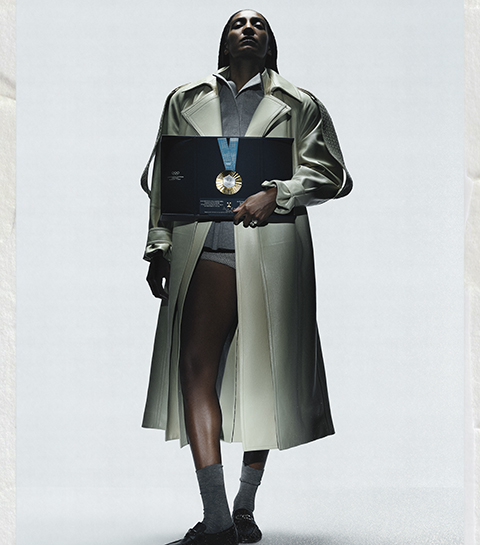

2. « Notre prochain coup d’un soir, ce sera un robot »

Her

En 2017, un Chinois s’est marié avec un robot qu’il avait lui-même fabriqué. Ancien ingénieur chez Huawei, l’homme s’était reconverti dans la robotique et l’intelligence artificielle. Les sex robots, eux, existent déjà et le scénario de « Her » avec Scarlett Johansson n’est pas si éloigné de la réalité. Il y a deux ans déjà, une start-up planchait sur une IA comparable à Samantha dans le film de Spike Jones. Son petit nom ? Asteria. On peut la transporter partout avec soi dans un boîtier, lui demander d’organiser notre journée, ou plus si affinités…

« C’est absolument possible que nous développions des histoires d’amour avec des robots dans le futur, ou que ce soit déjà en train de se produire à une certaine échelle », affirme Anne Lise Kjaer. Futurologue danoise de renommée internationale, elle a donné des conférences au MIT ou à Cambridge notamment. La preuve ? Une étude de l’Université de Duisbourg-Essen en Allemagne a démontré, à l’aide d’une IRM cérébrale, que les participants éprouvaient autant d’empathie pour les humains que pour les robots. « Avoir une histoire d’amour avec une IA, ça semble être l’option la plus safe. C’est plus prévisible et moins compliqué que les relations entre humains. Mais c’est peut-être aussi incroyablement plus ennuyant. » Si vous avez un jour un crush pour un robot, lui, en revanche, ne sera jamais amoureux de vous.

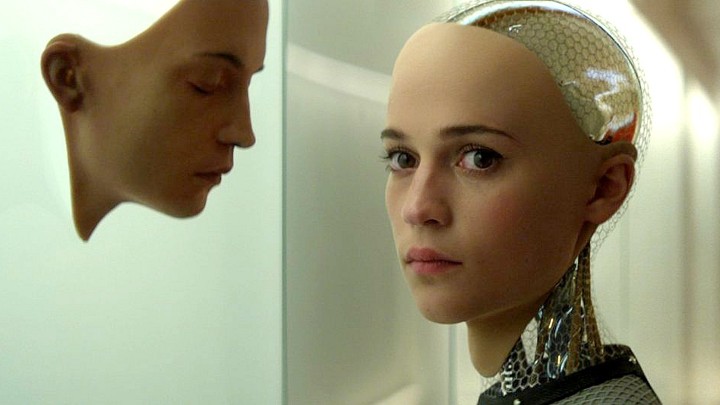

3. « Les robots vont nous voler nos jobs et tous nous mettre au chômage »

Ex Machina

Comme à chaque révolution, des milliers de jobs vont disparaître mais une série de nouvelles fonctions émergeront. Qui aurait pensé percer dans le community management ? Dans le futur, les experts en cybersécurité seront de plus en plus demandés par exemple, pour éviter qu’une intelligence artificielle ne soit hackée et devienne dangereuse. Dans la catégorie nouveaux métiers, la revue Harvard Business Review parle aussi de « psydesigner » (un psy qui imagine les personnalités de nos assistants virtuels), d’« egoteller » (un scénariste pour écrire les dialogues de nos assistants personnels) ou encore d’« éthicien » (pour éviter que les algorithmes soient biaisés à cause des préjugés de leurs créateurs).

On le sait, ce sont sur nos compétences émotionnelles et créatives qu’il faudra miser. Alors oui, les IA ont déjà écrit la suite d’Harry Potter, de nouveaux épisodes de Friends ou encore une chanson inspirée des Beatles mais elles ne feront probablement jamais de l’ombre aux artistes et aux artisans. Au lieu de penser qu’elles vont nous remplacer, il faut plutôt les voir comme de nouvelles alliées. Plutôt que de déplacer eux-mêmes des colis, des employés d’Amazon dirigent désormais des teams de robots qui le font à leur place. Résultat ? Un job plus intéressant et moins fatiguant. « On travaillera sûrement moins qu’avant et notre temps sera utilisé à des occupations diverses qui alimenteront fortement une industrie en plein boom : celle du divertissement », prédit Aurélie Jean, codeuse et docteure en science.

4. « Les robots jugeront si oui ou non, ce mec a assassiné notre voisine »

Minority Report

Le scénario de « Minory Report » avec Tom Cruise vous faisait flipper ? On n’est plus très loin de la réalité. Dans le film, un logiciel permet de prédire les crimes qui n’ont pas encore été commis et de condamner leurs « auteurs ». Dans la vraie vie, une série d’Etats aux States utilisent des « logiciels prédictifs » pour évaluer les risques de récidive. Traduisez : des intelligences artificielles aident les juges à décider si un prévenu doit être mis en liberté sous caution ou condamné. Le problème ? Le logiciel s’est avéré « légèrement plus efficace qu’un pile ou face » et surtout ultra biaisé. Une enquête a démontré que lorsqu’une personne est noire, l’algorithme a deux fois plus tendance à estimer qu’elle est à risque. Et il sous-estime les risques de récidive pour les Blancs…

En résumé, il augmente les injustices et les inégalités qui existent déjà dans notre société. Utiliser une intelligence artificielle pour « lire » des milliers de pages de procédure, textes de lois, jurisprudence et rapports d’experts, pourquoi pas. Mais compter sur des algorithmes pour émettre un avis sur une décision judiciaire, ça paraît évidemment dangereux. Si l’on fait confiance aux juges, c’est justement parce que ce sont des humains. Des personnes qui écoutent leur intuition, tiennent compte du contexte, des circonstances atténuantes et délivrent un jugement personnalisé.

5. « Comme tout bon citoyen, les robots auront des droits et des devoirs »

A.I.

L’année passée, l’Arabie Saoudite a accordé la citoyenneté à Sofia, un robot humanoïde (qui a certainement plus de droits que les femmes du pays) et en avril dernier, une intelligence artificielle s’affichait sur des tracts électoraux au Japon… Les IA auront-elles bientôt des droits et des devoirs comme nous ? Et le harcèlement sexuel dont elles sont victimes, on en parle ? « On ne pense pas que les robots ont besoin d’être protégés pour le moment. Mais ça peut devenir un problème si les stéréotypes se renforcent et qu’une désensibilisation s’opère. Il ne faudrait pas que les gens trouvent ça normal d’abuser d’un robot, et par extension de leur copine ou de leur femme », explique Anne Lise Kjaer.

« Un robot ne peut pas avoir de droits, ce n’est ni une personne physique ni une personne morale et ça me paraît dangereux, philosophiquement et légalement », ajoute Aurélie Jean. « Ceci dit, on sait que les humains peuvent éprouver de l’empathie et souffrir pour des robots. Ça pourrait être intéressant d’exiger une absence d’agression physique et verbale sur une intelligence artificielle dans le but de nous protéger. Mais ce n’est en aucun cas un droit envers le robot, ce serait un droit envers l’humain. »

Retour sur le futur

Ray Kurzweil, directeur de l’ingénierie de Google, estime que l’IA forte dépassera l’intelligence de l’ensemble des êtres humains en 2045. Sur les 146 annonces faites par le futurologue avant 2010, 115 se sont révélées exactes. Un taux de réussite de 86%… Et ses autres prédictions ?

> 2022 : Les USA et l’Europe adopteront des lois réglementant les relations entre les individus et les robots.

> 2027 : Un robot personnel capable d’accomplir des actions complexes en toute autonomie sera aussi anodin qu’une machine à café.

> 2033 : Les voitures sans conducteur circuleront sur les routes.

> 2034 : Une compagne virtuelle pourrait être équipée d’un « corps » en projetant une image dans la rétine de l’œil des humains.

> 2038 : L’apparition de personnes robotisées.

> 2040 : La recherche ne se fera pas uniquement par la voix, mais aussi par la pensée, et les résultats seront affichés sur des lentilles ou des lunettes.

> 2042 : La première réalisation potentielle de l’immortalité.

> 2044 : L’intelligence non-biologique sera des milliards de fois plus intelligente que son homologue biologique.

D’AUTRES ARTICLES:

- Enquête: l’intelligence artificielle est-elle sexiste?

- Où sont les femmes scientifiques en Belgique?

- Procréation médicalement assistée en Belgique: enquête et témoignages